Fonction d'optimisation dans Deep Learning Training Ppt

Cet ensemble de diapositives explique les fonctions d'optimisation dans le cadre de Deep Learning. Ceux-ci incluent Stochastic Gradient Descent, Adagrad, Adadelta et Adam Adaptive Moment Estimation.

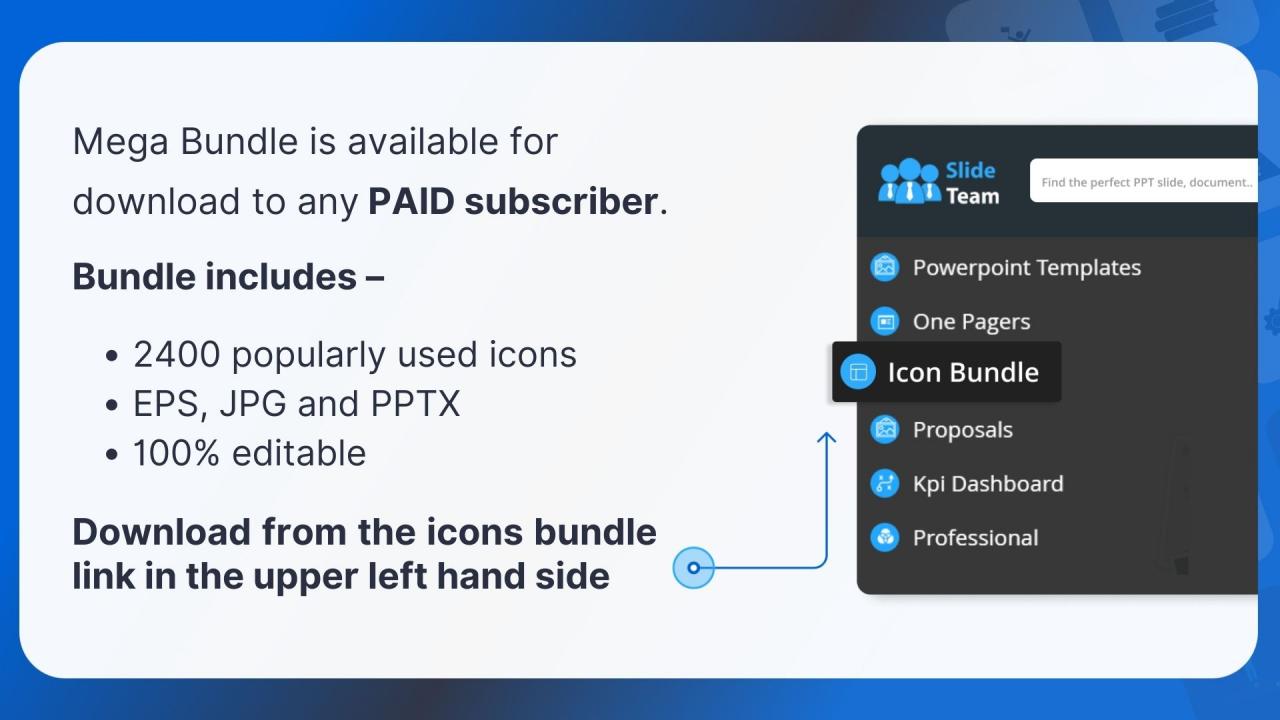

You must be logged in to download this presentation.

Caractéristiques de ces diapositives de présentation PowerPoint :

People who downloaded this PowerPoint presentation also viewed the following :

Contenu de cette présentation Powerpoint

Diapositive 1

Cette diapositive répertorie les fonctions de l'optimiseur dans le cadre de Deep Learning. Ceux-ci incluent la descente de gradient stochastique, adagrad, adadelta et adam (estimation adaptative du moment).

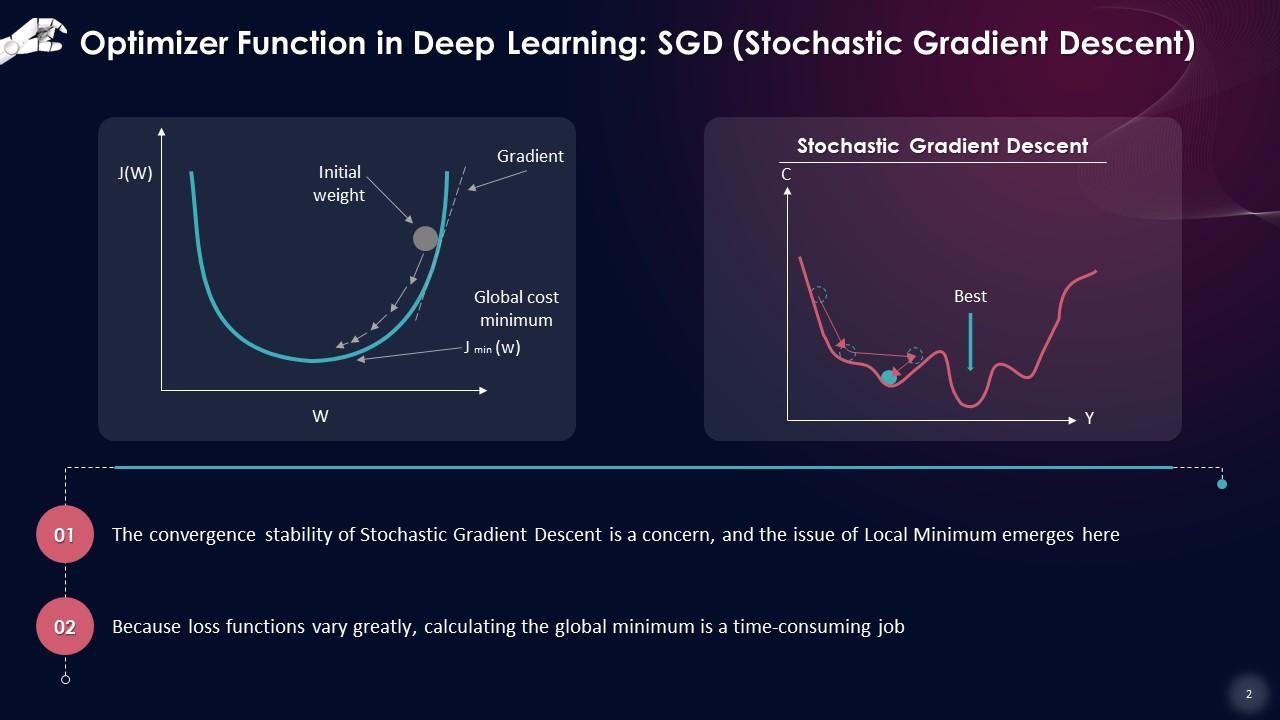

Diapositive 2

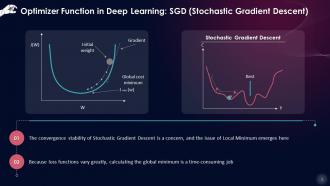

Cette diapositive indique que la stabilité de la convergence de la descente de gradient stochastique est préoccupante, et la question du minimum local émerge ici. Les fonctions de perte variant considérablement, le calcul du minimum global prend du temps.

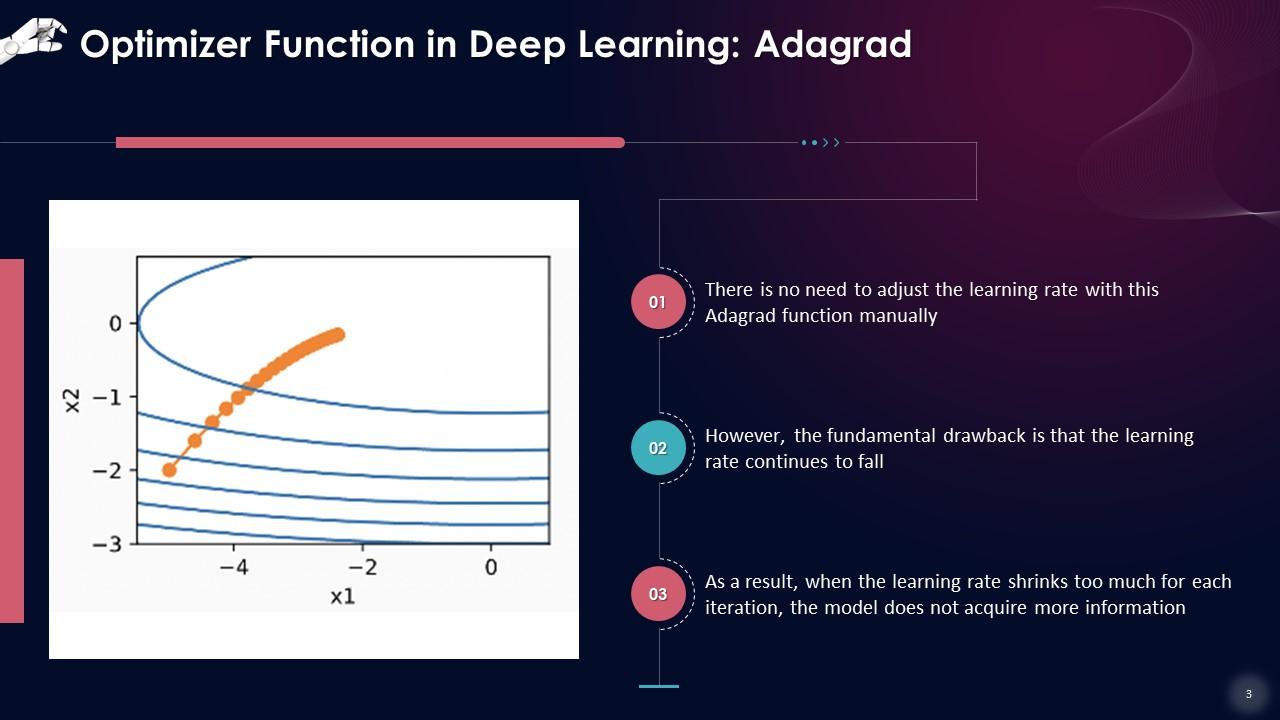

Diapositive 3

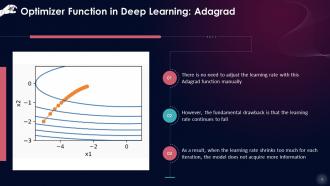

Cette diapositive indique qu'il n'est pas nécessaire d'ajuster manuellement le taux d'apprentissage avec cette fonction Adagrad. Cependant, l'inconvénient fondamental est que le taux d'apprentissage continue de baisser. Par conséquent, lorsque le taux d'apprentissage diminue trop à chaque itération, le modèle n'acquiert pas plus d'informations.

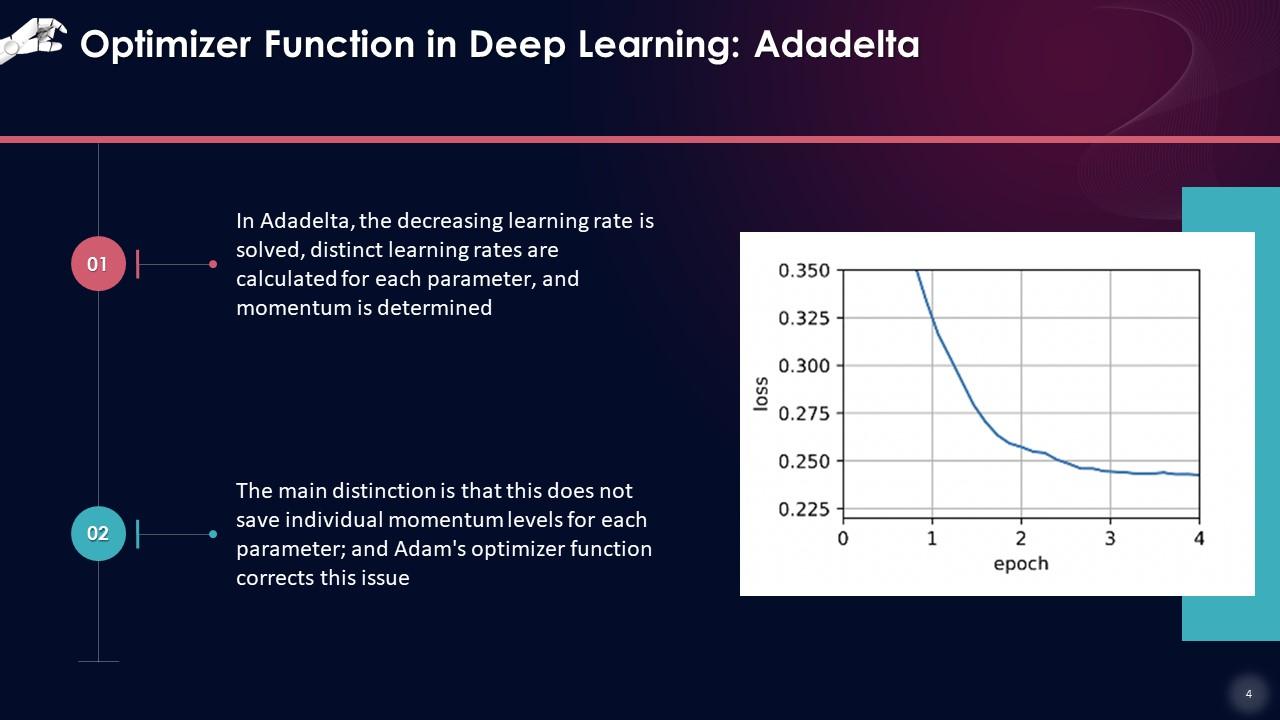

Diapositive 4

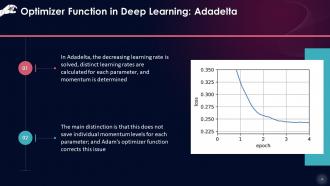

Cette diapositive indique que dans Adadelta, le taux d'apprentissage décroissant est résolu, des taux d'apprentissage distincts sont calculés pour chaque paramètre et la dynamique est déterminée. La principale distinction est que cela n'enregistre pas les niveaux d'impulsion individuels pour chaque paramètre ; et la fonction d'optimisation d'Adam corrige ce problème.

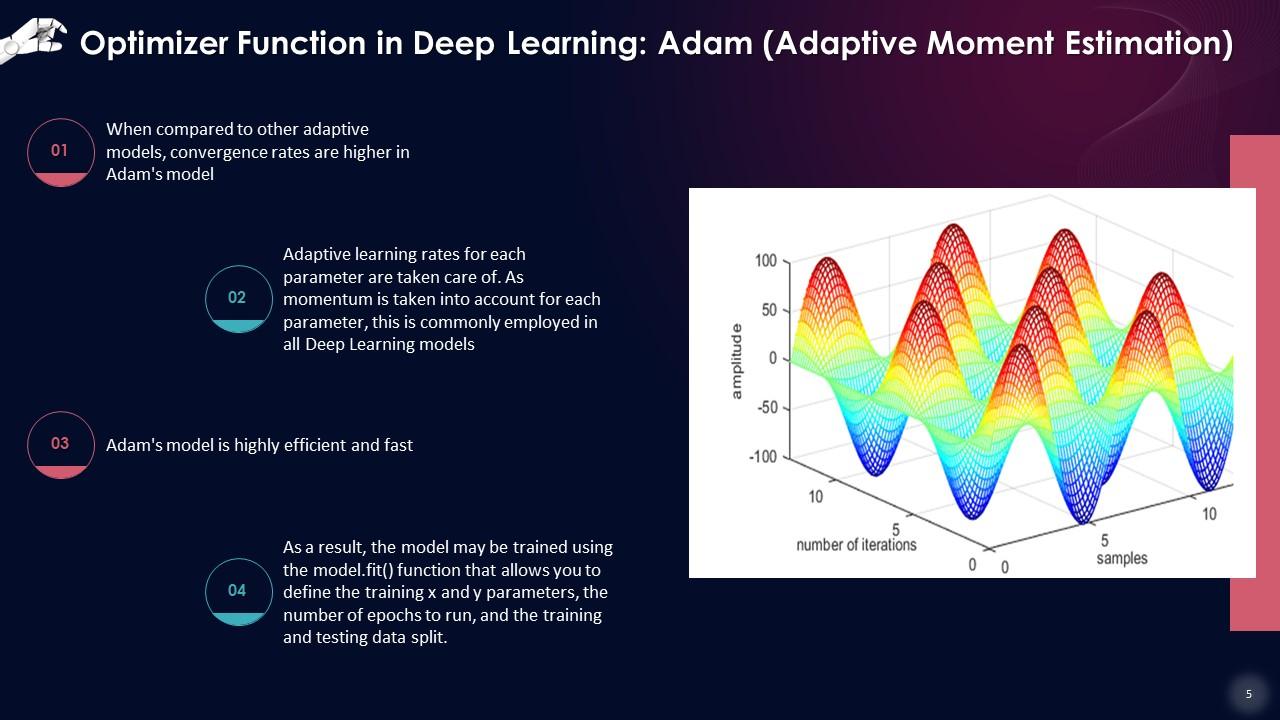

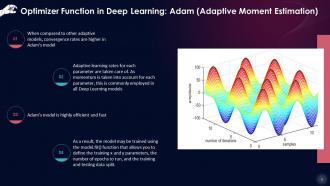

Diapositive 5

Cette diapositive décrit que, par rapport à d'autres modèles adaptatifs, les taux de convergence sont plus élevés dans le modèle d'Adam. Des taux d'apprentissage adaptatifs pour chaque paramètre sont pris en charge. Comme l'élan est pris en compte pour chaque paramètre, cela est couramment utilisé dans tous les modèles d'apprentissage en profondeur. Le modèle d'Adam est très efficace et rapide.

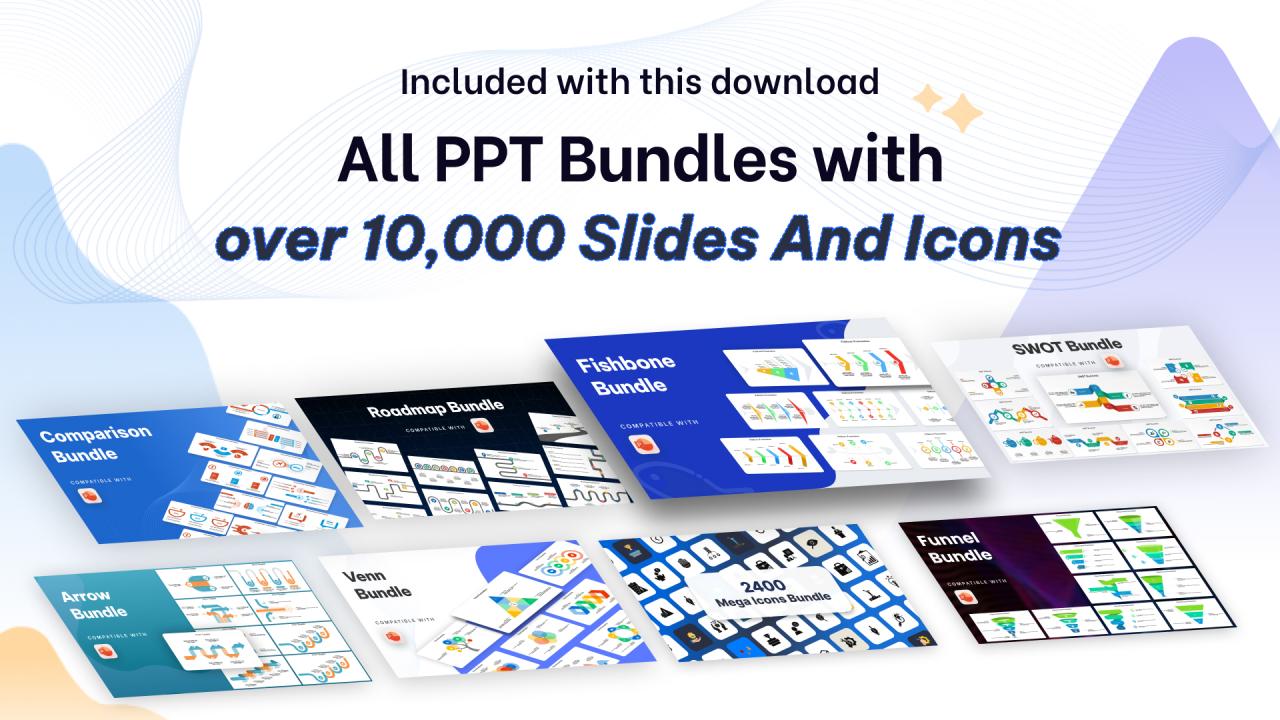

Fonction d'optimisation dans Deep Learning Training Ppt avec les 21 diapositives :

Utilisez notre fonction d'optimisation dans Deep Learning Training Ppt pour vous aider efficacement à économiser votre temps précieux. Ils sont prêts à l'emploi pour s'adapter à n'importe quelle structure de présentation.

-

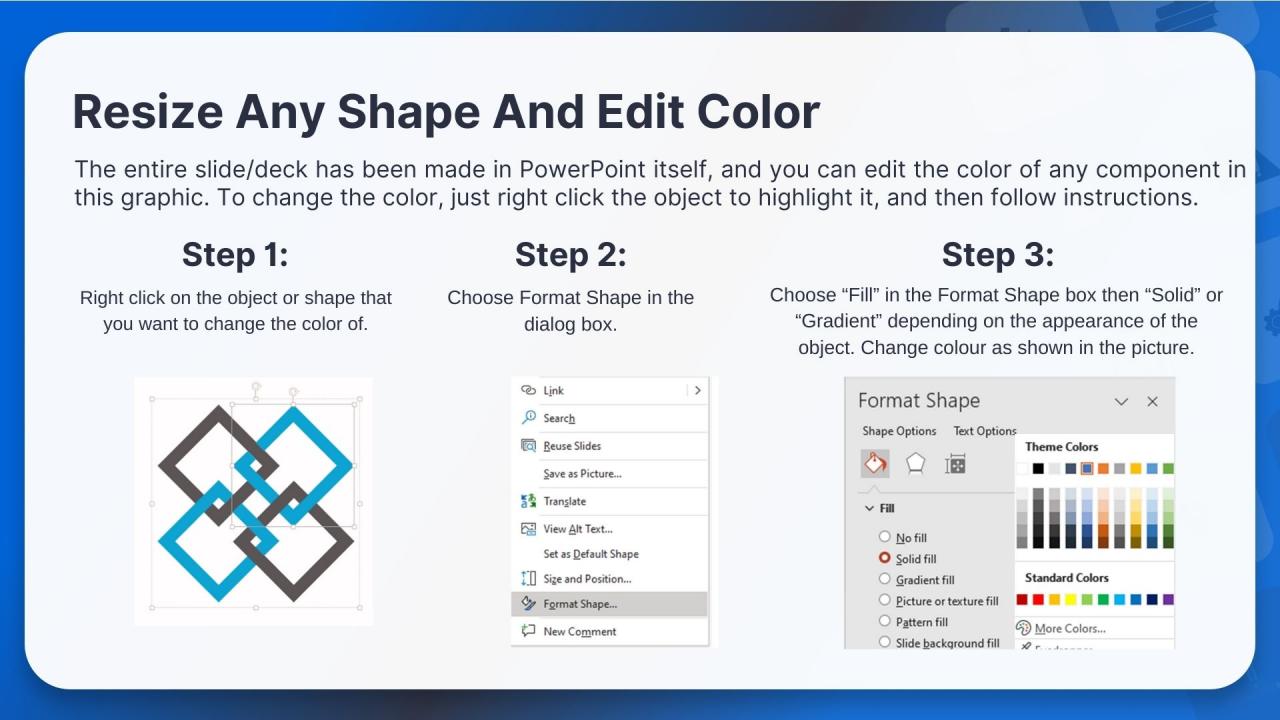

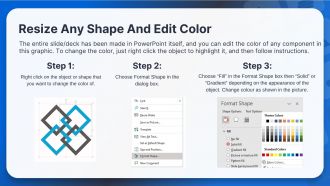

Very unique, user-friendly presentation interface.

-

The design is very attractive, informative, and eye-catching, with bold colors that stand out against all the basic presentation templates.