Formation sur les variantes des architectures de réseaux de neurones récurrents Ppt

Cet ensemble de diapositives PPT fournit des informations sur les variantes des architectures de réseaux de neurones récurrents. Ceux-ci incluent les réseaux de neurones récurrents bidirectionnels, la mémoire longue à court terme et les unités récurrentes fermées.

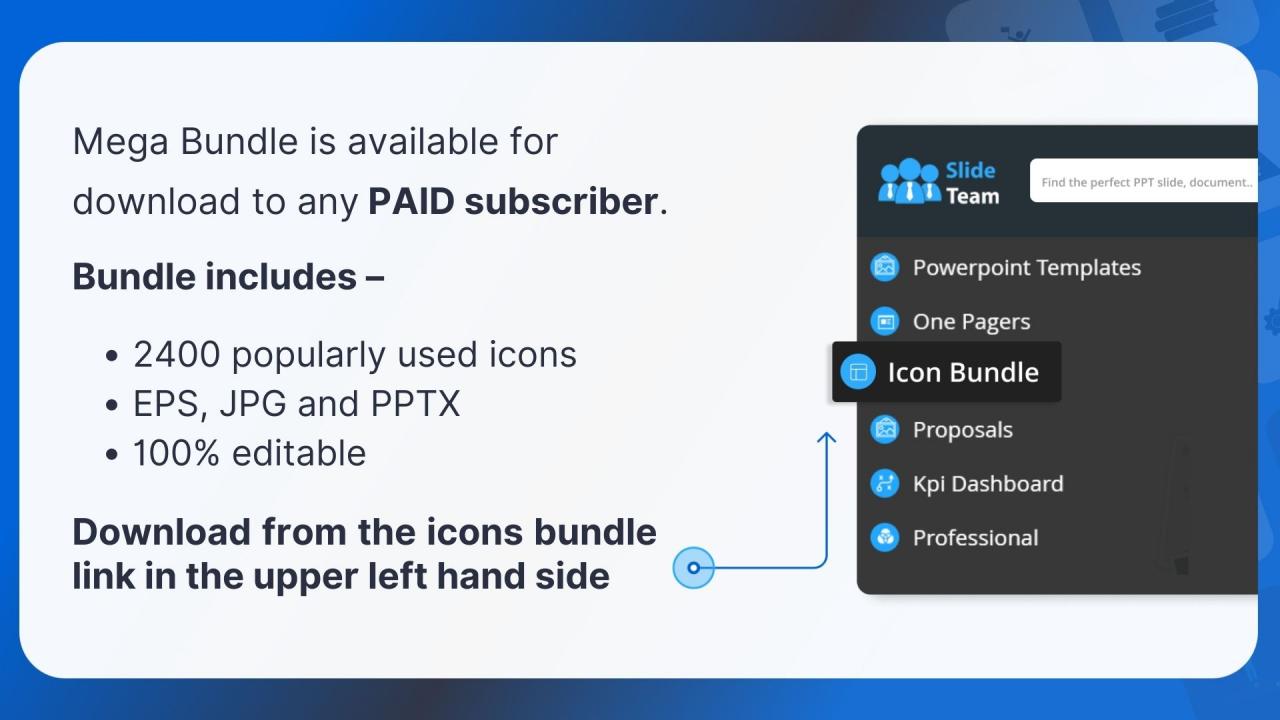

You must be logged in to download this presentation.

Caractéristiques de ces diapositives de présentation PowerPoint :

People who downloaded this PowerPoint presentation also viewed the following :

Contenu de cette présentation Powerpoint

Diapositive 1

Cette diapositive illustre trois variantes d'architectures de réseaux de neurones récurrents. Ceux-ci incluent les réseaux de neurones récurrents bidirectionnels, la mémoire longue à court terme et les unités récurrentes fermées.

Diapositive 2

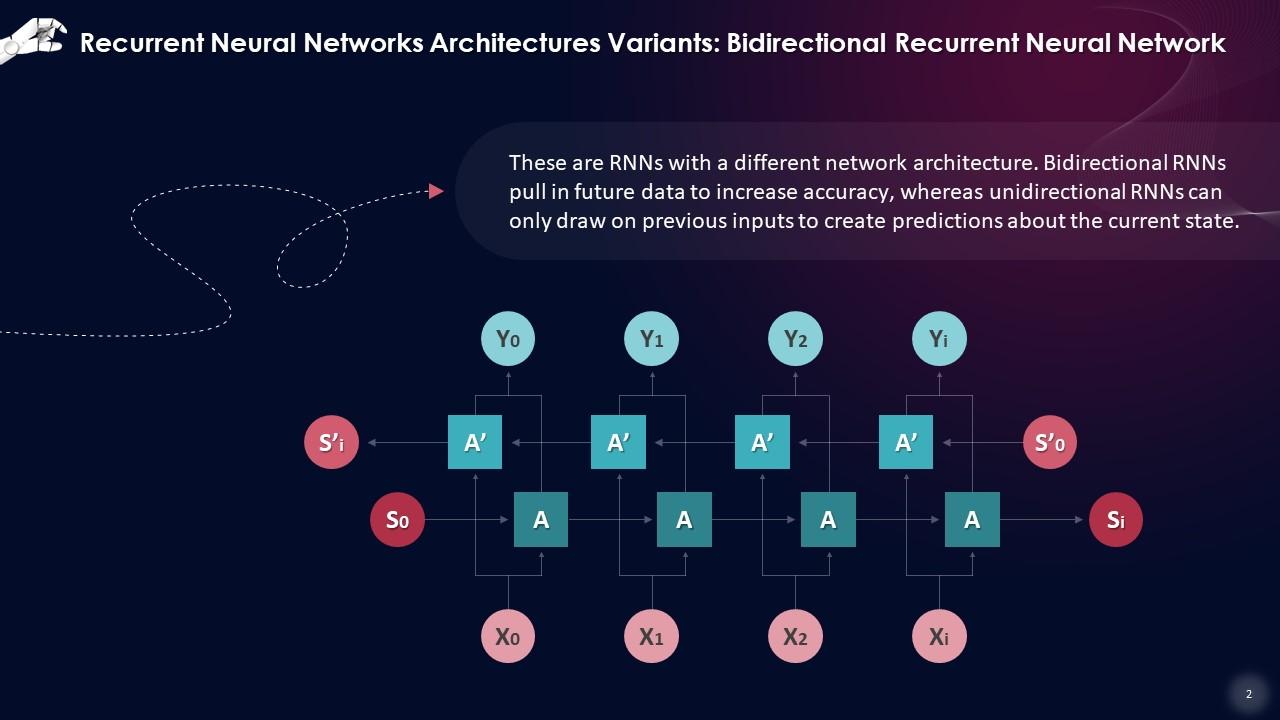

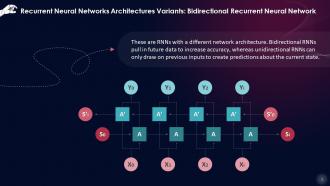

Cette diapositive présente le réseau neuronal récurrent bidirectionnel en tant qu'architecture. Les RNN bidirectionnels extraient les données futures pour augmenter la précision, tandis que les RNN unidirectionnels ne peuvent s'appuyer que sur les entrées précédentes pour créer des prédictions sur l'état actuel.

Diapositive 3

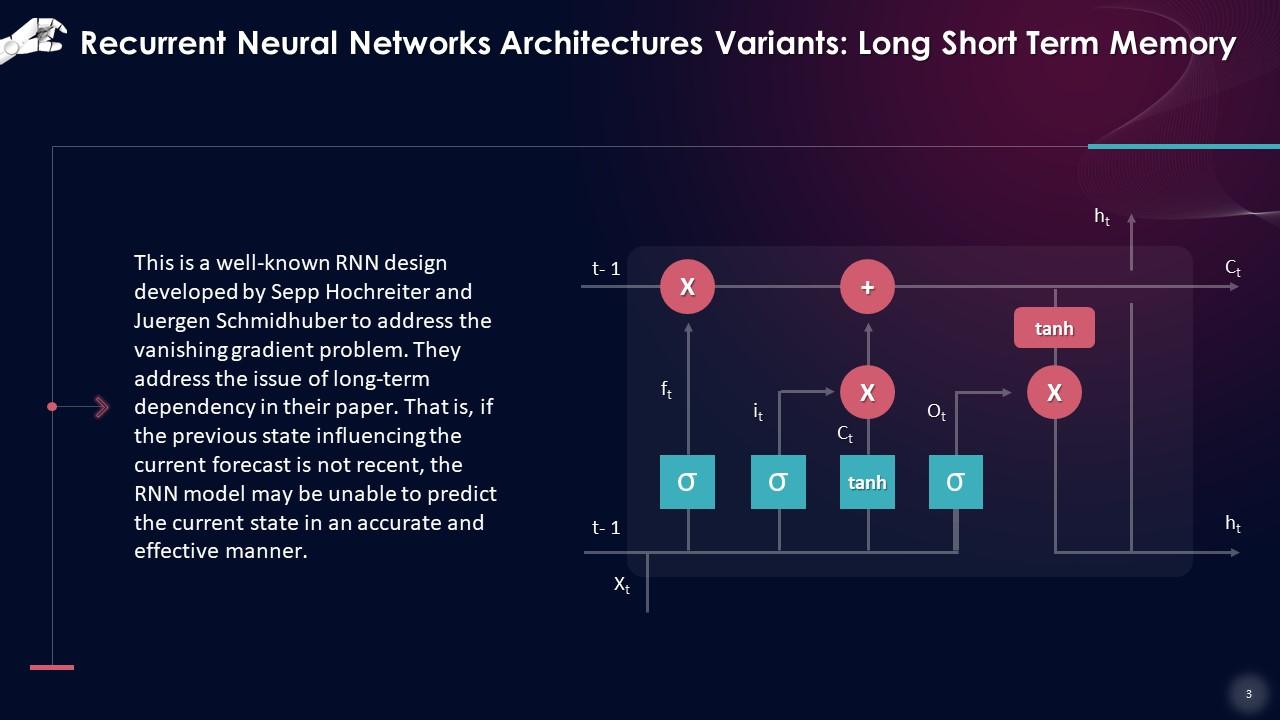

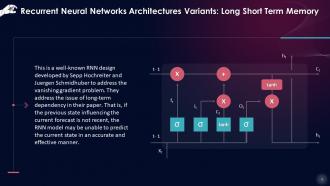

Cette diapositive donne des informations sur la mémoire à long court terme en tant qu'architecture. LSTM est une conception RNN bien connue développée par Sepp Hochreiter et Juergen Schmidhuber pour résoudre le problème du gradient de fuite.

Notes de l'instructeur : Dans les couches profondes du réseau de neurones, les LSTM ont des « cellules » qui ont trois portes : une porte d'entrée, une porte de sortie et une porte d'oubli. Ces portes régulent le flux de données nécessaires pour prévoir la sortie du réseau.

Diapositive 4

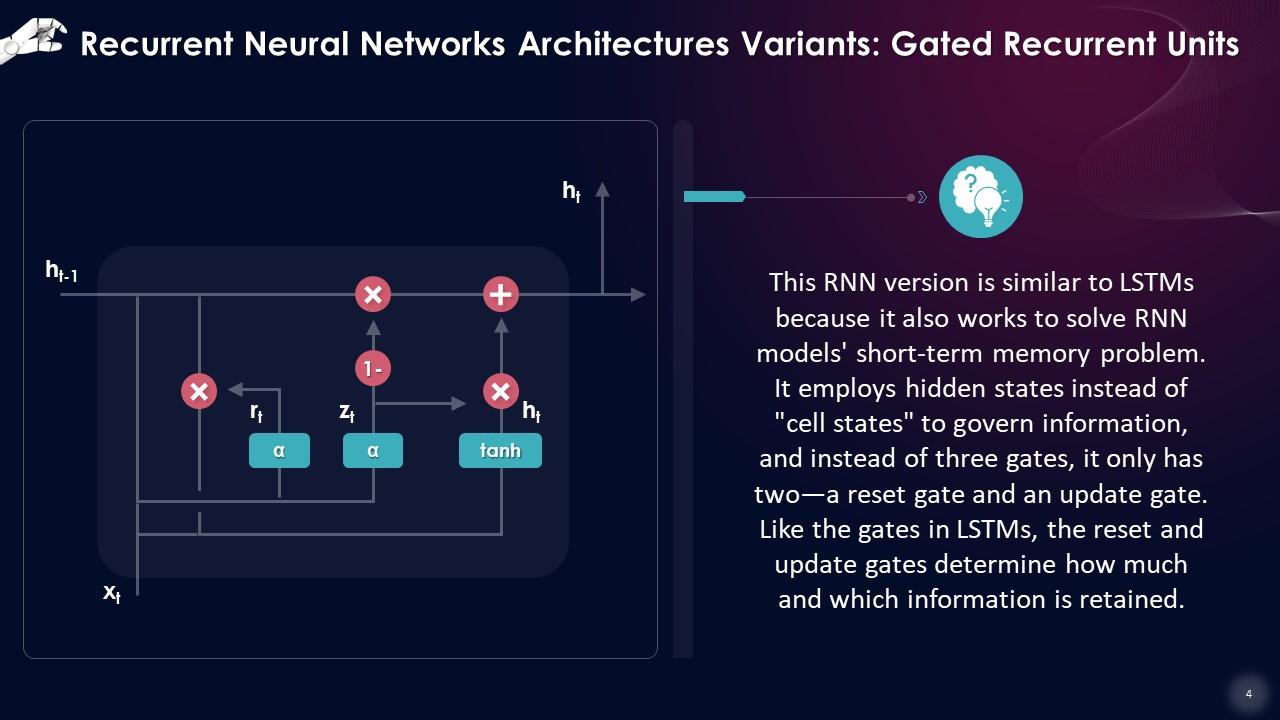

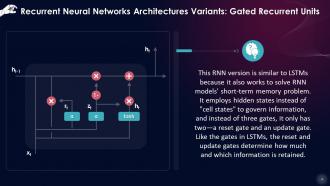

Cette diapositive présente les unités récurrentes fermées en tant qu'architecture. Cette version RNN est similaire aux LSTM car elle fonctionne également pour résoudre le problème de mémoire à court terme des modèles RNN. Il utilise des états cachés au lieu des "états de cellule" pour gérer les informations, et au lieu de trois portes, il n'en a que deux - une porte de réinitialisation et une porte de mise à jour.

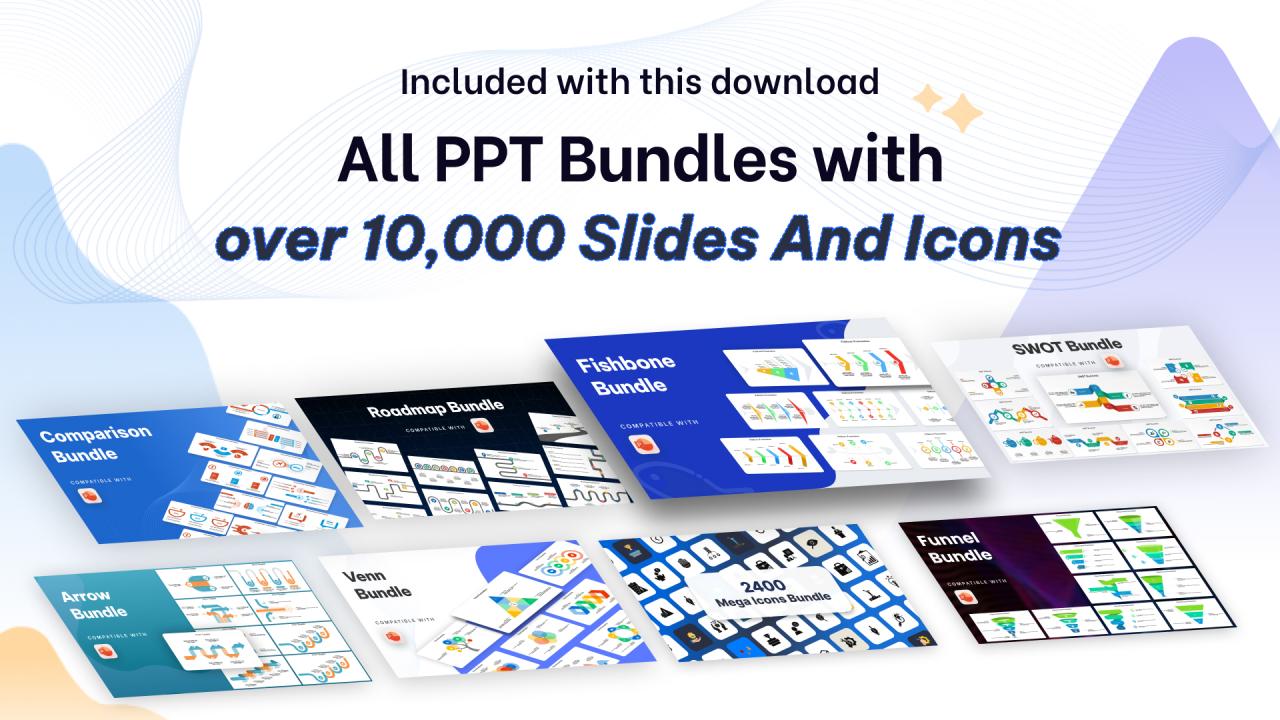

Variantes des architectures de réseaux de neurones récurrents Ppt de formation avec les 20 diapositives :

Utilisez notre Ppt de formation sur les variantes d'architectures de réseaux de neurones récurrents pour vous aider efficacement à économiser votre temps précieux. Ils sont prêts à l'emploi pour s'adapter à n'importe quelle structure de présentation.

-

SlideTeam, Please don’t stop sharing discount coupons! I love your occasional discounts and tend to buy your products around that corner.

-

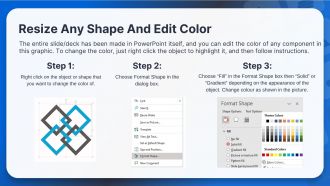

Extremely professional slides with attractive designs. I especially appreciate how easily they can be modified and come in different colors, shapes, and sizes!